이틀전 화염병 이어 두번째

일자리 대체 등 이유로 위협

오픈AI 사무실 폐쇄되기도

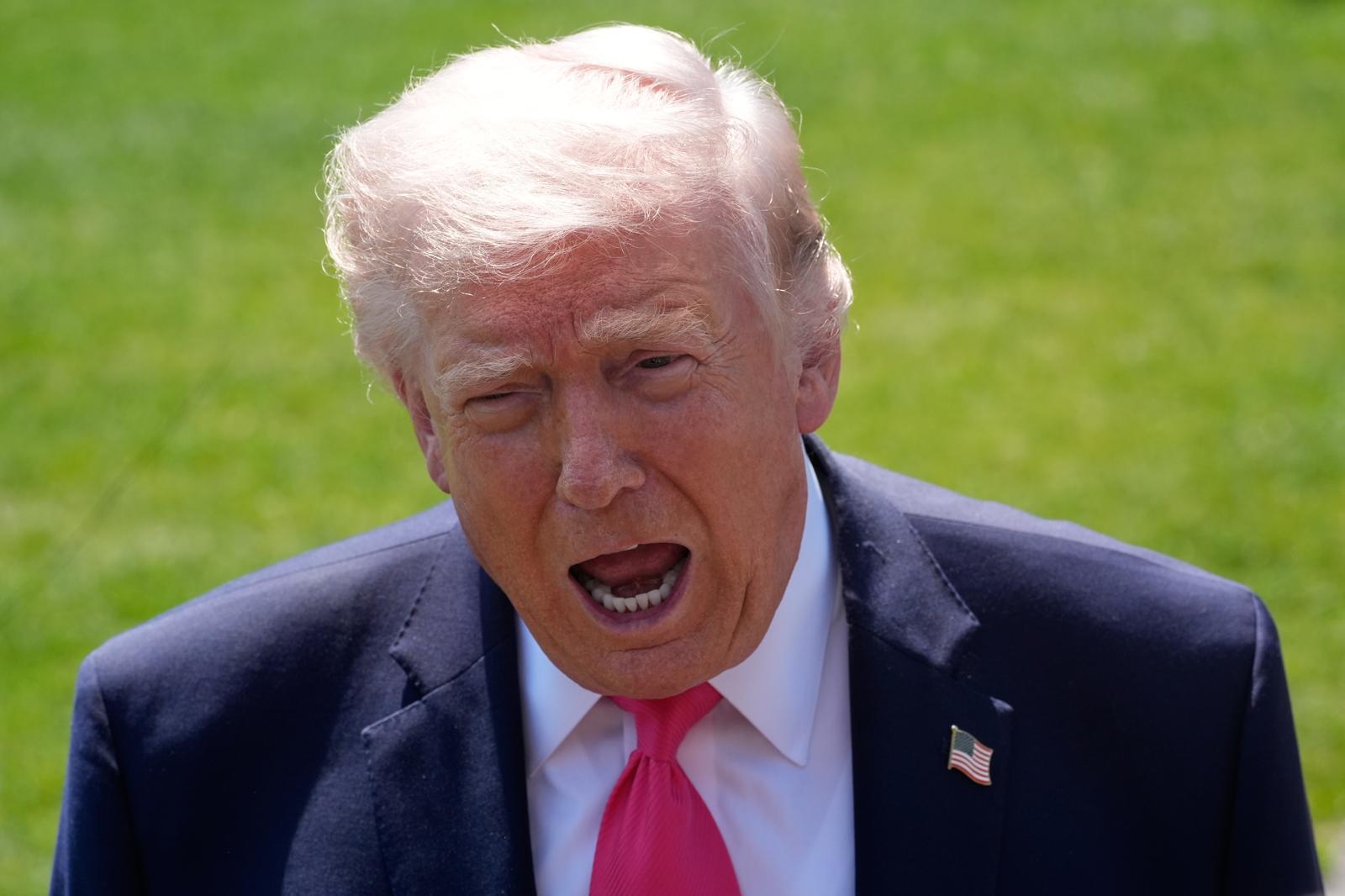

![샘 올트먼 오픈AI CEO [로이터=연합뉴스]](https://wimg.mk.co.kr/news/cms/202604/14/news-p.v1.20260413.4600a7ad95a8485f8902eed80513ec85_P1.png)

최근 인공지능(AI) 기술의 아이콘인 샘 올트먼 오픈AI 최고경영자 자택 앞에서 화염병 투척과 총격 사건이 연달아 발생했다. 기술을 바라보는 불안과 거부감이 위험천만한 범죄로 표출됐다는 점에서 우려를 금할 수 없다. 산업화의 물결 속에서 기계를 향해 망치를 들었던 19세기 러다이트 운동을 떠올리게 한다. 기술 혁명 과정에서 어느 정도의 진통은 불가피하지만 폭력 등으로 표출되는 반감은 개인이나 공동체 모두에게 바람직하지 않다.

외신에 따르면 지난 10일(현지시간) 샌프란시스코 노스비치에서 한 20대 남성이 올트먼 자택에 화염병을 투척했다. 12일에는 자택 앞에 차를 세우고 총격을 가한 용의자 2명이 체포됐다. 수사당국은 두 사건 모두 AI 기술에 대한 반감을 범행 동기로 보고 있다. 화염병 투척 용의자는 AI를 인류 멸종의 ‘실존적 위협’으로 규정하며, 올트먼 CEO를 병적인 거짓말쟁이라고 비난했다. 기술에 대한 왜곡된 이해가 언제든지 극단적 위협으로 번질 수 있음을 보여주는 사례다.

당연하게도, 특정 개인이나 기업을 겨눈 폭력과 저항은 기술 변화의 해법이 될 수 없다. 이는 강력한 제조업 기반의 한국 경제에도 무거운 함의를 갖는다. 생산성 혁신을 가져올 AI 기술의 파급은 한국 경제 생존에 선택이 아닌 필수다. 최근 이재명 대통령이 민주노총과 만난 자리에서 “너무 공포감을 가질 필요는 없다”고 당부한 것도 같은 맥락이다. 이 대통령은 로봇의 제조 현장 도입을 거부하는 노조 주장에 대해서도 “흘러오는 거대한 수레를 피할 수 없다”고 말했다.

기회와 위기의 두 얼굴을 가진 AI는 결국 그것을 어떻게 받아들이느냐에 달렸다. 막연한 불안이나 막무가내식 거부는 사회적 비용만 키운다. 노동시장은 과거 관성에서 벗어나 AI와 공존할 수 있는 유연성을 흡수해야 한다. 암기와 정답찾기 중심의 교육시장도 창의성과 문제해결력 같은 인간 고유의 역량을 키우는 데 집중해야 한다. 공포를 키우기보다 변화에 올라탈 준비와 용기를 갖는 게 이런 ‘AI 네이티브’가 될 수 있는 전제 조건이다. 위기는 무지에서, 기회는 준비에서 온다.

![[속보]이란 “레바논 휴전기간 호르무즈 완전 개방…조정된 항로 통해야”](https://dimg.donga.com/wps/NEWS/IMAGE/2026/04/17/133764155.1.jpg)

![[속보] 이란 "레바논 휴전기간 이란이 정한 항로로 호르무즈 완전 개방"](https://www.amuse.peoplentools.com/site/assets/img/broken.gif)

![[속보] 이란 "레바논 휴전기간 지정 항로로 호르무즈 완전 개방"](https://img.hankyung.com/photo/202604/01.43970614.1.jpg)

![[단독] '알파고 아버지' 10년 만에 방한…이세돌과 다시 만난다](https://img.hankyung.com/photo/202603/AA.43666527.1.jpg)

![[MK시그널] 로보티즈, 美 빅테크에 로봇 손 부품 공급 및 피지컬AI 수혜주 등에 주가 상승세, MK시그널 추천 후 상승률 12.83% 기록](https://pimg.mk.co.kr/news/cms/202603/20/news-p.v1.20260320.5ea8839301ed4284a9cb365ffae9579b_R.png)

English (US) ·

English (US) ·